Summary

Trong bối cảnh công nghệ ngày càng phát triển, Edge AI Vision đang trở thành một xu hướng quan trọng trong việc cách mạng hóa thị giác máy tính trên các thiết bị nhỏ gọn. Bài viết này sẽ đưa bạn đi vào thế giới của Edge AI Vision, khám phá những ưu điểm vượt trội mà nó mang lại cho cuộc sống hàng ngày cũng như các ngành công nghiệp khác nhau. Key Points:

- Sự tiến bộ của thuật toán và phần cứng đã tạo điều kiện cho Edge AI Vision phát triển mạnh mẽ, cho phép triển khai các mô hình phức tạp trên thiết bị nhỏ gọn.

- Edge AI Vision hội tụ nhiều công nghệ tiên tiến như vi xử lý hiệu suất cao và cảm biến chất lượng, mang lại sức mạnh tổng hợp giúp cải thiện ứng dụng trong nhiều lĩnh vực.

- Khả năng kết nối mở rộng nhờ vào 5G và LPWAN giúp thu thập dữ liệu quy mô lớn, đồng thời đảm bảo an toàn và bảo mật thông tin cá nhân.

Tại sao Edge AI Vision đang phát triển mạnh mẽ

### Giới thiệu - Tại sao Edge AI Vision đang bùng nổ

### Sức mạnh của AI trong tầm tay bạn

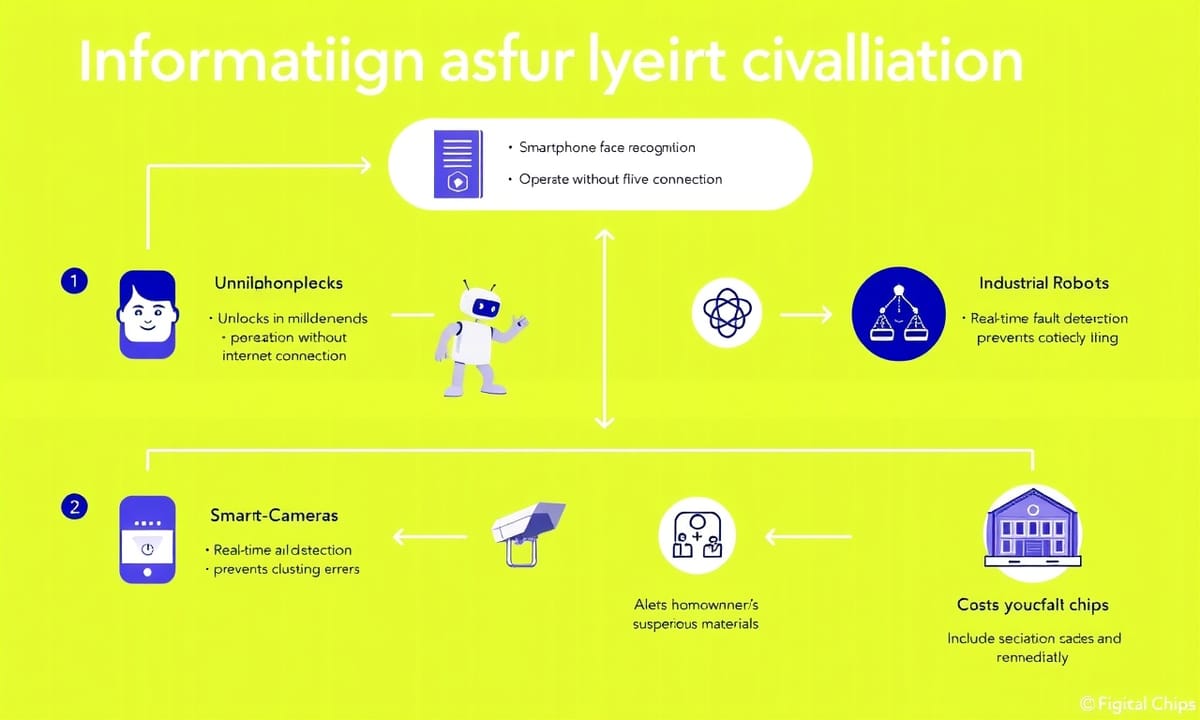

Hãy hình dung chiếc điện thoại thông minh của bạn có thể phát hiện đối tượng trong thời gian thực mà không cần kết nối internet. Hay một chiếc drone nhỏ có khả năng tránh chướng ngại vật ngay giữa không trung bằng cách xử lý video tức thì. Hoặc hãy nghĩ đến một camera an ninh nhận diện hoạt động đáng ngờ và cảnh báo cho bạn - tất cả đều diễn ra mà không cần gửi hình ảnh lên đám mây. Đó chính là **Edge AI Vision** – nơi các mô hình học sâu hoạt động trực tiếp trên những thiết bị nhỏ gọn, thay vì phụ thuộc vào các trung tâm dữ liệu xa xôi.

### Edge AI Vision là gì?

Nói một cách đơn giản, Edge AI Vision có nghĩa là thực hiện các tác vụ thị giác máy tính như phân loại hình ảnh, phát hiện đối tượng, phân đoạn hay nhận diện khuôn mặt ngay trên những thiết bị nhỏ như:

- Điện thoại thông minh và máy tính bảng

- Camera an ninh IoT

- Cảm biến công nghiệp

- Drone tiêu dùng

- Thiết bị đeo được

Các thiết bị này thường chỉ có sức mạnh tính toán, bộ nhớ và tuổi thọ pin hạn chế. Tuy nhiên, nhờ vào sự tiến bộ gần đây trong thiết kế mô hình học sâu và các kỹ thuật tối ưu hóa, chúng giờ đây có khả năng thực hiện những tác vụ thị giác phức tạp một cách độc lập.

### Sức mạnh của AI trong tầm tay bạn

Hãy hình dung chiếc điện thoại thông minh của bạn có thể phát hiện đối tượng trong thời gian thực mà không cần kết nối internet. Hay một chiếc drone nhỏ có khả năng tránh chướng ngại vật ngay giữa không trung bằng cách xử lý video tức thì. Hoặc hãy nghĩ đến một camera an ninh nhận diện hoạt động đáng ngờ và cảnh báo cho bạn - tất cả đều diễn ra mà không cần gửi hình ảnh lên đám mây. Đó chính là **Edge AI Vision** – nơi các mô hình học sâu hoạt động trực tiếp trên những thiết bị nhỏ gọn, thay vì phụ thuộc vào các trung tâm dữ liệu xa xôi.

### Edge AI Vision là gì?

Nói một cách đơn giản, Edge AI Vision có nghĩa là thực hiện các tác vụ thị giác máy tính như phân loại hình ảnh, phát hiện đối tượng, phân đoạn hay nhận diện khuôn mặt ngay trên những thiết bị nhỏ như:

- Điện thoại thông minh và máy tính bảng

- Camera an ninh IoT

- Cảm biến công nghiệp

- Drone tiêu dùng

- Thiết bị đeo được

Các thiết bị này thường chỉ có sức mạnh tính toán, bộ nhớ và tuổi thọ pin hạn chế. Tuy nhiên, nhờ vào sự tiến bộ gần đây trong thiết kế mô hình học sâu và các kỹ thuật tối ưu hóa, chúng giờ đây có khả năng thực hiện những tác vụ thị giác phức tạp một cách độc lập.

Edge AI Vision là gì và cách hoạt động

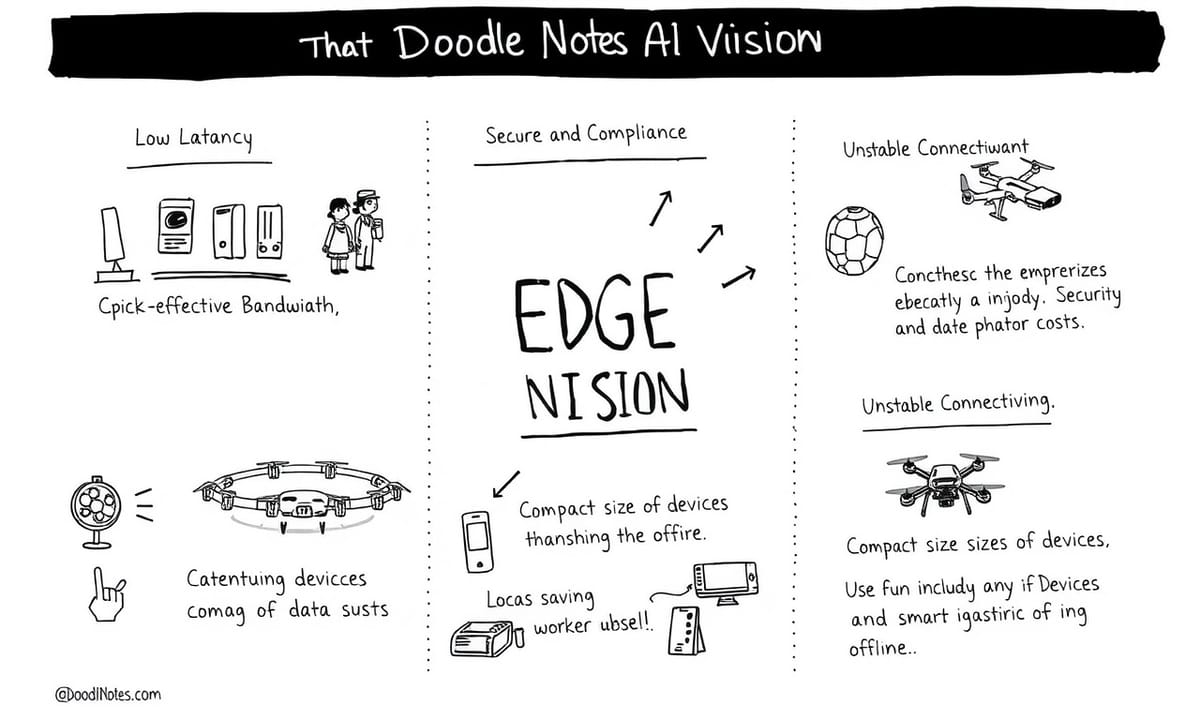

### Tại sao lại có sự bùng nổ đột ngột? Nhiều yếu tố đang thúc đẩy Edge AI Vision trở thành xu hướng chính thống:- **Độ trễ thấp**: Những quyết định như phát hiện người đi bộ trước một chiếc drone tự động cần phải được thực hiện trong vòng vài mili giây. Việc chờ phản hồi từ máy chủ đám mây có thể gây ra những trì hoãn nguy hiểm. - **Giảm chi phí băng thông**: Việc truyền tải hình ảnh độ phân giải cao hoặc video trực tiếp lên đám mây liên tục là rất tốn kém. Xử lý ngay tại chỗ giúp tiết kiệm đáng kể lượng băng thông sử dụng. - **Bảo mật và tuân thủ quy định**: Trong các lĩnh vực như chăm sóc sức khỏe, nhà thông minh và tài chính, việc gửi hình ảnh hoặc video nhạy cảm ra ngoài thiết bị sẽ dấy lên lo ngại về quyền riêng tư. Xử lý cục bộ giúp đáp ứng các quy định như GDPR bằng cách giữ dữ liệu an toàn hơn. - **Kết nối không ổn định hoặc xa xôi**: Các thiết bị ở vùng nông thôn, trên phương tiện di chuyển hay thậm chí trên biển không phải lúc nào cũng có internet nhanh và ổn định. Edge AI đảm bảo rằng chúng vẫn hoạt động hiệu quả ngay cả khi ngoại tuyến. ### Thiết bị nhỏ, ước mơ lớn Điều thú vị là kích thước của các thiết bị này ngày càng nhỏ gọn hơn. Hiện nay, với thiết kế kiến trúc tinh vi và tối ưu hóa thông minh, ngay cả những gadget sử dụng vi xử lý ARM khiêm tốn hay vi điều khiển cũng có thể thực hiện những tác vụ từng yêu cầu máy chủ lớn. Dù là một chiếc drone nano phát hiện cành cây giữa không trung hay một vòng tay theo dõi thể thao đếm số lần squat qua việc ước lượng tư thế, Edge AI Vision đang âm thầm biến đổi nhiều ngành công nghiệp khác nhau.

Extended Perspectives Comparison:

| Kỹ thuật nén mô hình | Lợi ích | Công cụ hỗ trợ |

|---|---|---|

| Lượng hóa | Giảm kích thước mô hình, tăng tốc độ xử lý, giảm tiêu thụ năng lượng | TensorFlow Lite, PyTorch Mobile, ONNX Runtime |

| Chuyển giao tri thức | Giúp mô hình nhỏ hơn giữ được độ chính xác cao khi học từ mô hình lớn | Không cần công cụ đặc biệt |

| Cắt tỉa | Loại bỏ các phần không cần thiết để giảm kích thước và cải thiện hiệu suất | TensorFlow Lite Optimizer |

| Triển khai và bảo trì ở quy mô lớn | Đảm bảo hoạt động đáng tin cậy trên hàng triệu thiết bị, cập nhật dễ dàng theo thời gian | Tối ưu hóa định dạng xuất khẩu |

Lợi ích của quyết định thời gian thực trong Edge AI

### Những gì bạn sẽ học trong bài viết này

Trong các phần tiếp theo, chúng tôi sẽ khám phá:

- Cách thu nhỏ các mô hình học sâu để phù hợp với bộ nhớ hạn chế

- Các kỹ thuật nén như cắt tỉa và lượng tử hóa

- Những kiến trúc nhẹ nhàng tốt nhất cho các nhiệm vụ hình ảnh

- Các tùy chọn phần cứng giúp tăng tốc độ xử lý hình ảnh trên thiết bị biên

- Một số mẹo thực tiễn cho việc triển khai và mở rộng trong thế giới thực

Edge AI Vision không chỉ là một xu hướng công nghệ - nó đang tạo ra một cuộc cách mạng thực sự mở ra những khả năng mới. Hãy cùng khám phá cách bạn có thể tận dụng cơ hội này.

## Lợi ích kinh doanh & UX của suy diễn tại chỗ

### Quyết định thời gian thực tạo ra tác động thực tế

Một trong những lợi thế lớn nhất của việc chạy các mô hình AI trực tiếp trên thiết bị chính là tốc độ. Khi một chiếc drone cần tránh một nhánh cây hoặc khi smartphone cần mở khóa bằng nhận diện khuôn mặt, không có thời gian để gửi dữ liệu lên đám mây và chờ phản hồi. Suy diễn tại chỗ cho phép các mô hình AI xử lý thông tin và đưa ra quyết định gần như ngay lập tức, dẫn đến trải nghiệm mượt mà, an toàn hơn và đáng tin cậy hơn.

Với độ trễ thấp, tiết kiệm băng thông và bảo mật dữ liệu cao hơn, hệ thống này tối ưu hóa hiệu suất của thuật toán học máy cho các thiết bị biên, chẳng hạn như mạng nơron tích chập (CNN) hay cây quyết định. Hơn nữa, sự phát triển của vật liệu và công nghệ cảm biến tiên tiến cũng góp phần nâng cao chất lượng hình ảnh cũng như khả năng xử lý nhanh chóng trong môi trường thực tế.

Trong các phần tiếp theo, chúng tôi sẽ khám phá:

- Cách thu nhỏ các mô hình học sâu để phù hợp với bộ nhớ hạn chế

- Các kỹ thuật nén như cắt tỉa và lượng tử hóa

- Những kiến trúc nhẹ nhàng tốt nhất cho các nhiệm vụ hình ảnh

- Các tùy chọn phần cứng giúp tăng tốc độ xử lý hình ảnh trên thiết bị biên

- Một số mẹo thực tiễn cho việc triển khai và mở rộng trong thế giới thực

Edge AI Vision không chỉ là một xu hướng công nghệ - nó đang tạo ra một cuộc cách mạng thực sự mở ra những khả năng mới. Hãy cùng khám phá cách bạn có thể tận dụng cơ hội này.

## Lợi ích kinh doanh & UX của suy diễn tại chỗ

### Quyết định thời gian thực tạo ra tác động thực tế

Một trong những lợi thế lớn nhất của việc chạy các mô hình AI trực tiếp trên thiết bị chính là tốc độ. Khi một chiếc drone cần tránh một nhánh cây hoặc khi smartphone cần mở khóa bằng nhận diện khuôn mặt, không có thời gian để gửi dữ liệu lên đám mây và chờ phản hồi. Suy diễn tại chỗ cho phép các mô hình AI xử lý thông tin và đưa ra quyết định gần như ngay lập tức, dẫn đến trải nghiệm mượt mà, an toàn hơn và đáng tin cậy hơn.

Với độ trễ thấp, tiết kiệm băng thông và bảo mật dữ liệu cao hơn, hệ thống này tối ưu hóa hiệu suất của thuật toán học máy cho các thiết bị biên, chẳng hạn như mạng nơron tích chập (CNN) hay cây quyết định. Hơn nữa, sự phát triển của vật liệu và công nghệ cảm biến tiên tiến cũng góp phần nâng cao chất lượng hình ảnh cũng như khả năng xử lý nhanh chóng trong môi trường thực tế.

Tiết kiệm chi phí với xử lý tại chỗ

Một số ví dụ thực tế bao gồm: **Điện thoại thông minh** có khả năng mở khóa chỉ trong vài mili giây bằng nhận diện khuôn mặt, ngay cả khi không có kết nối internet. - **Robot công nghiệp** phát hiện lỗi trên dây chuyền sản xuất theo thời gian thực, giúp ngăn chặn những sai lầm tốn kém. - **Camera thông minh** cảnh báo chủ nhà về các hoạt động đáng ngờ ngay khi chúng xảy ra. Trong những môi trường chuyển động nhanh, một sự chậm trễ chỉ nửa giây cũng có thể tạo ra sự khác biệt lớn. Bằng cách loại bỏ việc phải gửi dữ liệu lên đám mây, AI trên thiết bị cho phép phản ứng tức thì và quan trọng.

### Tiết kiệm chi phí băng thông và chi phí đám mây

Việc xử lý hình ảnh và video ngay trên thiết bị còn mang lại lợi ích tài chính đáng kể. Gửi một lượng lớn dữ liệu qua mạng và phụ thuộc vào điện toán đám mây cho mọi tác vụ có thể gây tốn kém rất nhanh chóng, đặc biệt là khi bạn phải xử lý các luồng video độ phân giải cao hoặc phục vụ hàng triệu người dùng. AI trên thiết bị cắt giảm các chi phí này bằng cách thực hiện phần lớn công việc tại địa phương. Thay vì tải lên từng khung hình hay bức ảnh, thiết bị chỉ cần gửi kết quả thỉnh thoảng, thông báo hoặc siêu dữ liệu đã nén khi cần thiết.

Ngoài ra, hiệu suất xử lý tại chỗ còn có thể được cải thiện hơn nữa nhờ tối ưu hóa thuật toán AI và sử dụng vật liệu thân thiện với môi trường trong sản xuất thiết bị. Việc áp dụng chip chuyên dụng như FPGA hoặc ASIC giúp tiết kiệm năng lượng tiêu thụ mà vẫn đảm bảo hiệu suất cao. Bên cạnh đó, triển khai công nghệ mã hóa dữ liệu cũng góp phần giảm thiểu băng thông truyền tải, từ đó tiết kiệm chi phí vận hành cho hệ thống.

### Tiết kiệm chi phí băng thông và chi phí đám mây

Việc xử lý hình ảnh và video ngay trên thiết bị còn mang lại lợi ích tài chính đáng kể. Gửi một lượng lớn dữ liệu qua mạng và phụ thuộc vào điện toán đám mây cho mọi tác vụ có thể gây tốn kém rất nhanh chóng, đặc biệt là khi bạn phải xử lý các luồng video độ phân giải cao hoặc phục vụ hàng triệu người dùng. AI trên thiết bị cắt giảm các chi phí này bằng cách thực hiện phần lớn công việc tại địa phương. Thay vì tải lên từng khung hình hay bức ảnh, thiết bị chỉ cần gửi kết quả thỉnh thoảng, thông báo hoặc siêu dữ liệu đã nén khi cần thiết.

Ngoài ra, hiệu suất xử lý tại chỗ còn có thể được cải thiện hơn nữa nhờ tối ưu hóa thuật toán AI và sử dụng vật liệu thân thiện với môi trường trong sản xuất thiết bị. Việc áp dụng chip chuyên dụng như FPGA hoặc ASIC giúp tiết kiệm năng lượng tiêu thụ mà vẫn đảm bảo hiệu suất cao. Bên cạnh đó, triển khai công nghệ mã hóa dữ liệu cũng góp phần giảm thiểu băng thông truyền tải, từ đó tiết kiệm chi phí vận hành cho hệ thống.

Bảo mật và bảo vệ dữ liệu với Edge AI Vision

Việc xử lý dữ liệu tại chỗ không chỉ giúp giảm chi phí máy chủ đám mây mà còn mang lại trải nghiệm mượt mà hơn cho các thiết bị ở những khu vực có kết nối hạn chế hoặc tốn kém. **Một số lợi ích về chi phí thường thấy bao gồm:** - Giảm mức sử dụng dữ liệu di động - Ít giờ tính toán GPU trên đám mây hơn - Hóa đơn lưu trữ đám mây nhỏ hơn. ### Bảo mật và Bảo vệ Dữ liệu Tích hợp Trong bối cảnh các luật bảo vệ dữ liệu cá nhân như GDPR và CCPA ngày càng trở nên nghiêm ngặt, việc giữ cho dữ liệu được xử lý ngay trên thiết bị đang trở thành một lợi thế cạnh tranh. Khi một thiết bị xử lý hình ảnh hoặc video nội bộ, không cần phải truyền tải dữ liệu nhạy cảm đến máy chủ. Điều này giúp dễ dàng tuân thủ pháp luật và cải thiện sự tin tưởng của khách hàng - mọi người sẵn sàng sử dụng các ứng dụng và thiết bị thông minh khi biết rằng hình ảnh riêng tư của họ không rời khỏi thiết bị. Một số ứng dụng nhạy cảm với quyền riêng tư rất hưởng lợi từ việc xử lý tại chỗ: - Camera an ninh gia đình với khả năng phát hiện người cục bộ - Thiết bị theo dõi sức khỏe phân tích hình ảnh tình trạng da - Ứng dụng ngân hàng xác minh tài liệu ID ngoại tuyến. Theo mặc định, việc suy diễn địa phương tôn trọng quyền riêng tư - điều này ngày càng trở thành kỳ vọng trong lòng người dùng hiện nay.

Kỹ thuật nén mô hình cho thiết bị nhỏ gọn

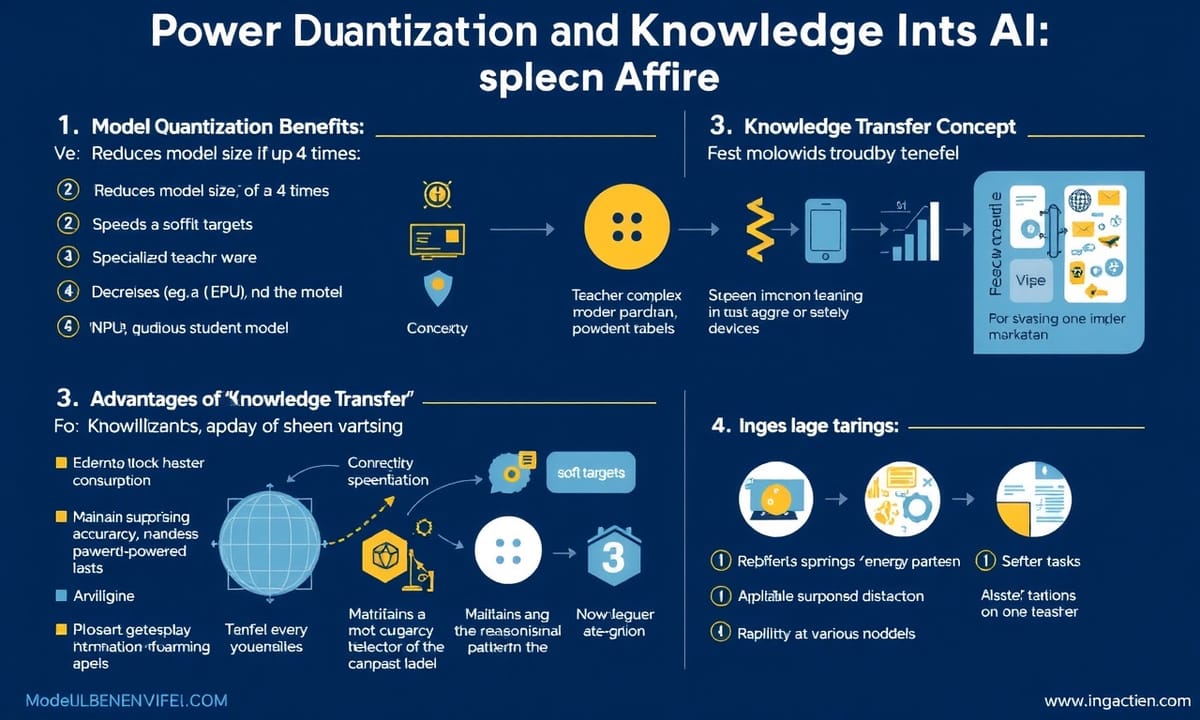

**Tại sao lượng hóa lại mạnh mẽ:** - Giảm đáng kể kích thước mô hình (lên đến 4 lần so với ban đầu) - Tăng tốc độ xử lý trên các phần cứng chuyên dụng (như NPUs và Edge TPUs) - Giảm mức tiêu thụ năng lượng, điều này rất quan trọng cho các thiết bị sử dụng pin. Lượng hóa là một trong những cách dễ dàng và hiệu quả nhất để biến mô hình trở nên "sẵn sàng cho edge", đặc biệt với sự hỗ trợ từ các bộ công cụ như TensorFlow Lite, PyTorch Mobile và ONNX Runtime.

### Chuyển giao tri thức: Dạy một mô hình nhỏ suy nghĩ lớn

Hãy tưởng tượng một mô hình phức tạp lớn (mô hình "giáo viên") quá nặng để có thể chạy trên thiết bị của bạn. **Chuyển giao tri thức** giúp huấn luyện một mô hình nhỏ hơn, nhanh hơn (mô hình "học sinh") bắt chước hành vi của giáo viên thay vì học trực tiếp từ dữ liệu gán nhãn.

**Cách hoạt động:**

- Mô hình giáo viên tạo ra các "đích mềm" - những đầu ra thông tin hơn so với nhãn đơn giản.

- Mô hình học sinh không chỉ học câu trả lời đúng mà còn hiểu cách suy nghĩ của giáo viên, nắm bắt được những mẫu tinh tế.

- Kết quả là, mô hình học sinh có thể nhỏ hơn và nhanh hơn nhưng vẫn giữ được phần lớn độ chính xác của giáo viên.

**Lợi ích của việc chuyển giao tri thức:**

- Giữ lại độ chính xác đáng ngạc nhiên trong các mô hình nhỏ.

- Có thể áp dụng cho nhiều nhiệm vụ khác nhau: phân loại, phát hiện, phân đoạn.

- Linh hoạt – bạn thậm chí có thể kết hợp nhiều mô hình thành một mô hình nhỏ duy nhất.

Phương pháp chuyển giao tri thức đặc biệt hữu ích khi các kỹ thuật nén như cắt tỉa hoặc lượng hóa không đủ để đáp ứng yêu cầu của thiết bị edge.

### Chuyển giao tri thức: Dạy một mô hình nhỏ suy nghĩ lớn

Hãy tưởng tượng một mô hình phức tạp lớn (mô hình "giáo viên") quá nặng để có thể chạy trên thiết bị của bạn. **Chuyển giao tri thức** giúp huấn luyện một mô hình nhỏ hơn, nhanh hơn (mô hình "học sinh") bắt chước hành vi của giáo viên thay vì học trực tiếp từ dữ liệu gán nhãn.

**Cách hoạt động:**

- Mô hình giáo viên tạo ra các "đích mềm" - những đầu ra thông tin hơn so với nhãn đơn giản.

- Mô hình học sinh không chỉ học câu trả lời đúng mà còn hiểu cách suy nghĩ của giáo viên, nắm bắt được những mẫu tinh tế.

- Kết quả là, mô hình học sinh có thể nhỏ hơn và nhanh hơn nhưng vẫn giữ được phần lớn độ chính xác của giáo viên.

**Lợi ích của việc chuyển giao tri thức:**

- Giữ lại độ chính xác đáng ngạc nhiên trong các mô hình nhỏ.

- Có thể áp dụng cho nhiều nhiệm vụ khác nhau: phân loại, phát hiện, phân đoạn.

- Linh hoạt – bạn thậm chí có thể kết hợp nhiều mô hình thành một mô hình nhỏ duy nhất.

Phương pháp chuyển giao tri thức đặc biệt hữu ích khi các kỹ thuật nén như cắt tỉa hoặc lượng hóa không đủ để đáp ứng yêu cầu của thiết bị edge.

Chọn phần cứng phù hợp cho Edge AI Vision

### Xây Dựng Một Quy Trình Nén Thông Minh

Trong các dự án AI biên giới thực tế, bạn thường kết hợp những kỹ thuật này:

1. **Đào tạo một mô hình lớn và chính xác** làm điểm khởi đầu.

2. **Cắt tỉa** những phần không cần thiết để làm cho nó nhẹ hơn.

3. **Lượng tử hóa** để giảm độ chính xác và kích thước.

4. **Chuyển giao tri thức** từ mô hình lớn sang một mô hình nhỏ hơn.

Bằng cách xếp chồng các phương pháp này một cách thông minh, có thể tạo ra những mô hình nhỏ hơn và nhanh hơn từ 10 đến 20 lần mà vẫn giữ được độ chính xác ở mức tối thiểu.

### Các Công Cụ Để Giúp Bạn Nén Một Cách Thông Minh

Có rất nhiều công cụ và thư viện phổ biến có thể tự động hóa một phần quy trình nén:

- **TensorFlow Lite Optimizer**: Để lượng tử hóa sau khi đào tạo và cắt tỉa.

- **PyTorch Mobile Quantization Toolkit**: Cho phép lượng tử hóa động và tĩnh.

- **ONNX Runtime Quantization Tool**: Tối ưu hóa cho các mô hình giữa các framework khác nhau.

- **NVIDIA TensorRT**: Tối ưu hóa cực mạnh trên phần cứng NVIDIA.

- **OpenVINO**: Bộ công cụ của Intel dành cho việc tối ưu hóa và triển khai trên các thiết bị biên.

Sử dụng đúng những công cụ này có thể giúp tiết kiệm thời gian của bạn rất nhiều cũng như nâng cao hiệu suất tối đa cho các thiết bị nhỏ gọn.

### Điểm Quan Trọng

Việc nén không chỉ đơn thuần là làm cho các mô hình nhỏ lại - mà còn là giúp AI thị giác biên trở nên thực tế. Cắt tỉa, lượng tử hóa, và chuyển giao tri thức là những kỹ năng cần thiết đối với bất kỳ ai nghiêm túc về việc triển khai học sâu trên di động, IoT, và hệ thống nhúng.

Trong các dự án AI biên giới thực tế, bạn thường kết hợp những kỹ thuật này:

1. **Đào tạo một mô hình lớn và chính xác** làm điểm khởi đầu.

2. **Cắt tỉa** những phần không cần thiết để làm cho nó nhẹ hơn.

3. **Lượng tử hóa** để giảm độ chính xác và kích thước.

4. **Chuyển giao tri thức** từ mô hình lớn sang một mô hình nhỏ hơn.

Bằng cách xếp chồng các phương pháp này một cách thông minh, có thể tạo ra những mô hình nhỏ hơn và nhanh hơn từ 10 đến 20 lần mà vẫn giữ được độ chính xác ở mức tối thiểu.

### Các Công Cụ Để Giúp Bạn Nén Một Cách Thông Minh

Có rất nhiều công cụ và thư viện phổ biến có thể tự động hóa một phần quy trình nén:

- **TensorFlow Lite Optimizer**: Để lượng tử hóa sau khi đào tạo và cắt tỉa.

- **PyTorch Mobile Quantization Toolkit**: Cho phép lượng tử hóa động và tĩnh.

- **ONNX Runtime Quantization Tool**: Tối ưu hóa cho các mô hình giữa các framework khác nhau.

- **NVIDIA TensorRT**: Tối ưu hóa cực mạnh trên phần cứng NVIDIA.

- **OpenVINO**: Bộ công cụ của Intel dành cho việc tối ưu hóa và triển khai trên các thiết bị biên.

Sử dụng đúng những công cụ này có thể giúp tiết kiệm thời gian của bạn rất nhiều cũng như nâng cao hiệu suất tối đa cho các thiết bị nhỏ gọn.

### Điểm Quan Trọng

Việc nén không chỉ đơn thuần là làm cho các mô hình nhỏ lại - mà còn là giúp AI thị giác biên trở nên thực tế. Cắt tỉa, lượng tử hóa, và chuyển giao tri thức là những kỹ năng cần thiết đối với bất kỳ ai nghiêm túc về việc triển khai học sâu trên di động, IoT, và hệ thống nhúng.

So sánh các tùy chọn phần cứng cho hiệu suất tối ưu

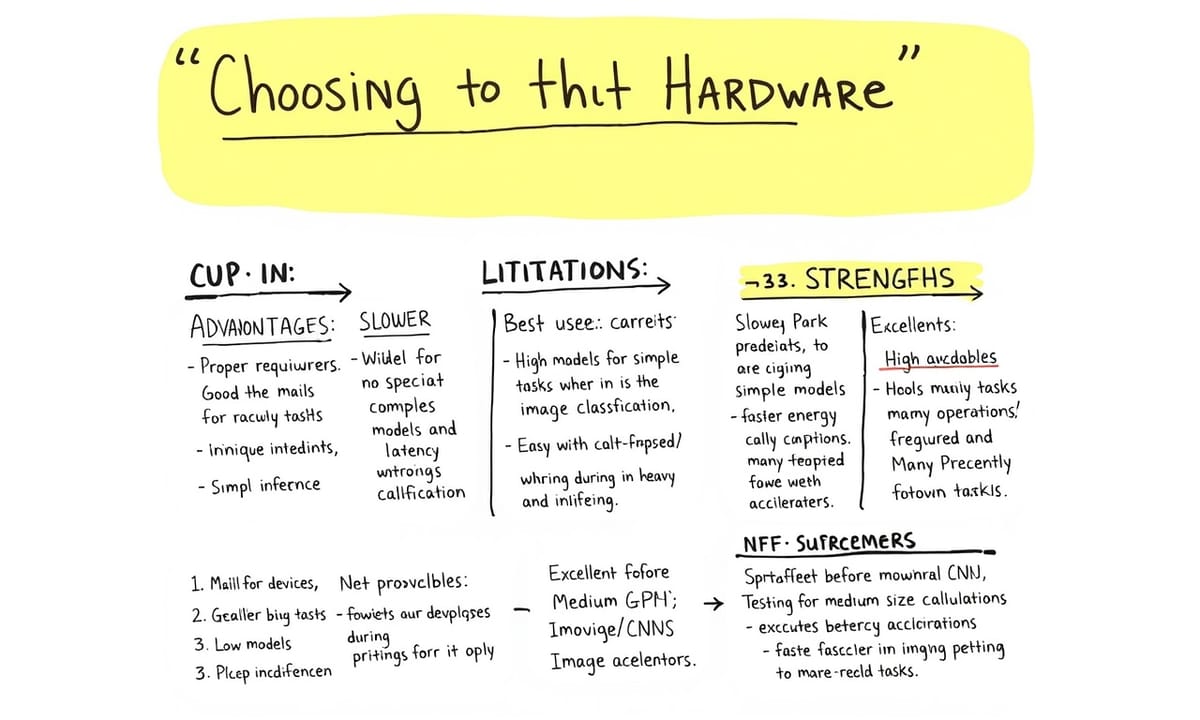

### Tại sao Lựa Chọn Phần Cứng Quan Trọng

Việc chọn lựa phần cứng phù hợp là rất quan trọng, bởi ngay cả những mô hình đã được tối ưu hóa và nhẹ nhất cũng có thể gặp khó khăn nếu chạy trên phần cứng không phù hợp. Các thiết bị Edge khác nhau sử dụng nhiều loại bộ xử lý, mỗi loại có những điểm mạnh và hạn chế riêng khi thực hiện các mô hình học sâu. Việc chọn đúng gia tốc phần cứng cũng quan trọng như việc chọn mô hình vậy. Một phần cứng tốt có thể tạo ra sự khác biệt giữa một thiết bị chậm chạp, tiêu tốn pin nhiều và một sản phẩm nhanh chóng, hiệu quả mang lại trải nghiệm mượt mà cho người dùng.

### CPU: Người Bạn Đáng Tin Cậy

Hầu hết mọi thiết bị đều có CPU, và các mô hình AI cơ bản có thể chạy trên đó mà không cần phần cứng đặc biệt.

**Ưu điểm của CPU:**

- Có sẵn phổ biến (không yêu cầu đặc biệt)

- Tốt cho các mô hình nhỏ và suy diễn ở tỷ lệ thấp

- Dễ phát triển và gỡ lỗi

**Hạn chế:**

- Chậm hơn với các mô hình phức tạp

- Tiêu thụ năng lượng cao hơn khi suy diễn nặng

- Không được tối ưu hóa cho các phép toán ma trận mà học sâu rất yêu thích

**Trường hợp sử dụng tốt nhất:**

- Các mô hình nhỏ cho nhiệm vụ đơn giản như phân loại ảnh

- Nhiệm vụ tần suất thấp nơi tốc độ không phải là yếu tố chính

- Thử nghiệm trước khi chuyển sang các gia tốc mạnh mẽ hơn

### GPU Di Động: Nhanh Hơn Và Song Song Hóa Tốt Hơn

Các smartphone và máy tính bảng hiện đại thường trang bị GPU (Bộ Xử Lý Đồ Họa) giúp thực hiện các tác vụ học sâu nhanh hơn đáng kể so với CPU.

**Một số GPU di động phổ biến bao gồm:**

- Adreno (Qualcomm)

- Mali (ARM)

- GPU Apple (trong iPhone và iPad)

**Điểm mạnh của GPU:**

- Khả năng xử lý song song cao: có thể thực hiện nhiều phép toán cùng lúc

- Rất tốt cho CNN kích thước trung bình và các tác vụ liên quan đến ảnh

- Thường hỗ trợ FP16 (số dấu phẩy đôi 16 bit) để suy diễn nhanh hơn với tiêu tốn điện năng ít hơn

**Những điều cần lưu ý:**

- Độ phức tạp trong lập trình (cần framework chuyên dụng như Metal, Vulkan hoặc OpenCL)

- Có khả năng giảm hiệu suất do nhiệt độ cao dưới tải lâu dài

- Sự tăng đột ngột về năng lượng ban đầu trong thời gian sử dụng nặng

**Trường hợp sử dụng tốt nhất:**

- Nhận diện đối tượng theo thời gian thực trên điện thoại và máy tính bảng

- Các ứng dụng AI Edge Vision cần trải nghiệm người dùng mượt mà

Việc chọn lựa phần cứng phù hợp là rất quan trọng, bởi ngay cả những mô hình đã được tối ưu hóa và nhẹ nhất cũng có thể gặp khó khăn nếu chạy trên phần cứng không phù hợp. Các thiết bị Edge khác nhau sử dụng nhiều loại bộ xử lý, mỗi loại có những điểm mạnh và hạn chế riêng khi thực hiện các mô hình học sâu. Việc chọn đúng gia tốc phần cứng cũng quan trọng như việc chọn mô hình vậy. Một phần cứng tốt có thể tạo ra sự khác biệt giữa một thiết bị chậm chạp, tiêu tốn pin nhiều và một sản phẩm nhanh chóng, hiệu quả mang lại trải nghiệm mượt mà cho người dùng.

### CPU: Người Bạn Đáng Tin Cậy

Hầu hết mọi thiết bị đều có CPU, và các mô hình AI cơ bản có thể chạy trên đó mà không cần phần cứng đặc biệt.

**Ưu điểm của CPU:**

- Có sẵn phổ biến (không yêu cầu đặc biệt)

- Tốt cho các mô hình nhỏ và suy diễn ở tỷ lệ thấp

- Dễ phát triển và gỡ lỗi

**Hạn chế:**

- Chậm hơn với các mô hình phức tạp

- Tiêu thụ năng lượng cao hơn khi suy diễn nặng

- Không được tối ưu hóa cho các phép toán ma trận mà học sâu rất yêu thích

**Trường hợp sử dụng tốt nhất:**

- Các mô hình nhỏ cho nhiệm vụ đơn giản như phân loại ảnh

- Nhiệm vụ tần suất thấp nơi tốc độ không phải là yếu tố chính

- Thử nghiệm trước khi chuyển sang các gia tốc mạnh mẽ hơn

### GPU Di Động: Nhanh Hơn Và Song Song Hóa Tốt Hơn

Các smartphone và máy tính bảng hiện đại thường trang bị GPU (Bộ Xử Lý Đồ Họa) giúp thực hiện các tác vụ học sâu nhanh hơn đáng kể so với CPU.

**Một số GPU di động phổ biến bao gồm:**

- Adreno (Qualcomm)

- Mali (ARM)

- GPU Apple (trong iPhone và iPad)

**Điểm mạnh của GPU:**

- Khả năng xử lý song song cao: có thể thực hiện nhiều phép toán cùng lúc

- Rất tốt cho CNN kích thước trung bình và các tác vụ liên quan đến ảnh

- Thường hỗ trợ FP16 (số dấu phẩy đôi 16 bit) để suy diễn nhanh hơn với tiêu tốn điện năng ít hơn

**Những điều cần lưu ý:**

- Độ phức tạp trong lập trình (cần framework chuyên dụng như Metal, Vulkan hoặc OpenCL)

- Có khả năng giảm hiệu suất do nhiệt độ cao dưới tải lâu dài

- Sự tăng đột ngột về năng lượng ban đầu trong thời gian sử dụng nặng

**Trường hợp sử dụng tốt nhất:**

- Nhận diện đối tượng theo thời gian thực trên điện thoại và máy tính bảng

- Các ứng dụng AI Edge Vision cần trải nghiệm người dùng mượt mà

Quy trình triển khai và bảo trì mô hình quy mô lớn

### Các NPU và Chip AI Chuyên Dụng: Tốc Độ và Hiệu Quả

Ngày nay, nhiều thiết bị mới được trang bị các **Bộ Xử Lý Thần Kinh (NPU)** hoặc **chip AI biên giới** được thiết kế đặc biệt cho việc học sâu.

**Một số ví dụ bao gồm:**

- Apple Neural Engine (ANE)

- Qualcomm Hexagon DSP với khả năng tăng tốc AI

- Google Edge TPU (sử dụng trong các thiết bị Coral)

- MediaTek APU

- Rockchip NPU (phổ biến trong các thiết bị IoT giá rẻ)

**Tại sao NPU lại tuyệt vời:**

- Được xây dựng riêng cho các phép toán học sâu như nhân ma trận, tích chập

- Tiêu thụ điện năng rất thấp

- Xử lý tốt các mô hình đã định lượng (đặc biệt là INT8)

**Hạn chế:**

- Có thể cần chuyển đổi mô hình (ví dụ sang định dạng TensorFlow Lite hoặc ONNX)

- Thiếu tính linh hoạt so với CPU và GPU đa năng

**Các trường hợp sử dụng tốt nhất:**

- Các tác vụ AI thời gian thực, tần suất cao

- Các nhiệm vụ liên quan đến hình ảnh trên thiết bị chạy pin

- Camera thông minh, drone, cảm biến công nghiệp

### Edge TPUs và Chip Chuyên Dụng

Đối với những ứng dụng cần hiệu suất cực kỳ cao, chip chuyên dụng như Google Edge TPU hay dòng sản phẩm NVIDIA Jetson có thể tạo ra sự khác biệt lớn.

**Một số điểm chính về Edge TPU:**

- Được thiết kế để tăng tốc cho các mô hình nhỏ gọn đã định lượng

- Tiêu thụ điện năng siêu thấp

- Kích thước nhỏ gọn - có thể vừa vặn bên trong camera, router và vi điều khiển

**Thách thức:**

- Cần tối ưu hóa mô hình mạnh mẽ để đạt được độ chính xác cao (thường chỉ hỗ trợ INT8)

**Lý tưởng cho:**

- Triển khai IoT quy mô lớn

- Bán lẻ thông minh, nông nghiệp và giám sát môi trường

- Thiết bị siêu nhỏ gọn chạy bằng pin

### AI Tích Hợp Cảm Biến: Xử Lý Ngay Tại Nguồn

Một số cảm biến hiện đại giờ đây đã tích hợp sẵn khả năng AI cơ bản ngay bên trong chúng.

**Ví dụ:**

- Dòng cảm biến Sony IMX500 bao gồm một bộ xử lý mạng thần kinh mini

- Một số camera nhiệt và cảm biến chuyển động có bộ phân loại đơn giản tích hợp sẵn

**Lợi ích của AI trên cảm biến:**

- Độ trễ cực thấp (không cần gửi toàn bộ hình ảnh đến bộ xử lý chính)

- Tiết kiệm điện năng hệ thống và băng thông

- Phù hợp cho các nhiệm vụ thị giác đơn giản như phát hiện chuyển động hay nhận diện đối tượng cơ bản

**Giới hạn:**

- Chỉ thích hợp cho những mô hình cực kỳ đơn giản

- Khó khăn hơn trong việc nâng cấp hoặc tùy chỉnh sau khi triển khai

Ngày nay, nhiều thiết bị mới được trang bị các **Bộ Xử Lý Thần Kinh (NPU)** hoặc **chip AI biên giới** được thiết kế đặc biệt cho việc học sâu.

**Một số ví dụ bao gồm:**

- Apple Neural Engine (ANE)

- Qualcomm Hexagon DSP với khả năng tăng tốc AI

- Google Edge TPU (sử dụng trong các thiết bị Coral)

- MediaTek APU

- Rockchip NPU (phổ biến trong các thiết bị IoT giá rẻ)

**Tại sao NPU lại tuyệt vời:**

- Được xây dựng riêng cho các phép toán học sâu như nhân ma trận, tích chập

- Tiêu thụ điện năng rất thấp

- Xử lý tốt các mô hình đã định lượng (đặc biệt là INT8)

**Hạn chế:**

- Có thể cần chuyển đổi mô hình (ví dụ sang định dạng TensorFlow Lite hoặc ONNX)

- Thiếu tính linh hoạt so với CPU và GPU đa năng

**Các trường hợp sử dụng tốt nhất:**

- Các tác vụ AI thời gian thực, tần suất cao

- Các nhiệm vụ liên quan đến hình ảnh trên thiết bị chạy pin

- Camera thông minh, drone, cảm biến công nghiệp

### Edge TPUs và Chip Chuyên Dụng

Đối với những ứng dụng cần hiệu suất cực kỳ cao, chip chuyên dụng như Google Edge TPU hay dòng sản phẩm NVIDIA Jetson có thể tạo ra sự khác biệt lớn.

**Một số điểm chính về Edge TPU:**

- Được thiết kế để tăng tốc cho các mô hình nhỏ gọn đã định lượng

- Tiêu thụ điện năng siêu thấp

- Kích thước nhỏ gọn - có thể vừa vặn bên trong camera, router và vi điều khiển

**Thách thức:**

- Cần tối ưu hóa mô hình mạnh mẽ để đạt được độ chính xác cao (thường chỉ hỗ trợ INT8)

**Lý tưởng cho:**

- Triển khai IoT quy mô lớn

- Bán lẻ thông minh, nông nghiệp và giám sát môi trường

- Thiết bị siêu nhỏ gọn chạy bằng pin

### AI Tích Hợp Cảm Biến: Xử Lý Ngay Tại Nguồn

Một số cảm biến hiện đại giờ đây đã tích hợp sẵn khả năng AI cơ bản ngay bên trong chúng.

**Ví dụ:**

- Dòng cảm biến Sony IMX500 bao gồm một bộ xử lý mạng thần kinh mini

- Một số camera nhiệt và cảm biến chuyển động có bộ phân loại đơn giản tích hợp sẵn

**Lợi ích của AI trên cảm biến:**

- Độ trễ cực thấp (không cần gửi toàn bộ hình ảnh đến bộ xử lý chính)

- Tiết kiệm điện năng hệ thống và băng thông

- Phù hợp cho các nhiệm vụ thị giác đơn giản như phát hiện chuyển động hay nhận diện đối tượng cơ bản

**Giới hạn:**

- Chỉ thích hợp cho những mô hình cực kỳ đơn giản

- Khó khăn hơn trong việc nâng cấp hoặc tùy chỉnh sau khi triển khai

Cách xuất và tối ưu hóa mô hình để sử dụng trên thiết bị

### Điểm chính

Chọn phần cứng phù hợp không chỉ là một chi tiết kỹ thuật - mà còn là một quyết định chiến lược có thể mở khóa những trải nghiệm người dùng tốt hơn, thời gian sử dụng pin lâu hơn, chi phí thấp hơn và thời gian đưa ra thị trường nhanh hơn. Bằng cách khớp nhu cầu của mô hình với khả năng của thiết bị, bạn có thể tạo ra những giải pháp AI biên tuyệt vời mà cảm giác mượt mà, thông minh và liền mạch.

Trong phần tiếp theo, chúng ta sẽ chuyển từ việc xây dựng và nén mô hình sang việc thực sự triển khai chúng - và duy trì hoạt động tốt ở quy mô lớn.

## Quy trình Triển khai & Bảo trì Ở Quy Mô Lớn

### Tại Sao Việc Triển Khai Cần Sự Chú Ý Đặc Biệt

Việc đào tạo và nén một mô hình chỉ mới hoàn thành một nửa chặng đường. Thực sự đưa nó vào hoạt động đáng tin cậy trên hàng nghìn (hoặc triệu) thiết bị trong thế giới thực - và giữ cho nó được cập nhật và hiệu quả theo thời gian - là nơi nhiều dự án Edge AI gặp khó khăn.

Triển khai các mô hình thị giác trên các thiết bị nhỏ cần phải đóng gói cẩn thận, thử nghiệm kỹ lưỡng và lập kế hoạch cho các bản cập nhật trong tương lai. Hãy cùng khám phá quy trình triển khai thông minh trông như thế nào.

### Bước 1: Xuất Và Tối Ưu Mô Hình

Khi mô hình của bạn đã được đào tạo và nén xong, bước tiếp theo là **xuất** nó sang định dạng mà thiết bị mục tiêu của bạn có thể sử dụng.

**Các định dạng phổ biến cho thiết bị biên:**

- TensorFlow Lite (.tflite): Tuyệt vời cho Android, vi điều khiển và Coral Edge TPU.

- ONNX (.onnx): Tiêu chuẩn mở linh hoạt, hỗ trợ nhiều môi trường chạy khác nhau.

- Core ML (.mlmodel): Cần thiết cho các thiết bị iOS (iPhone, iPad).

- NNAPI / Metal: Các lớp tăng tốc phần cứng bản địa cho Android và iOS.

**Tối ưu hóa trong quá trình xuất khẩu:**

- Áp dụng quantization sau đào tạo nếu cần.

- Loại bỏ các phép toán không sử dụng để đơn giản hóa đồ thị của mô hình.

- Giảm độ chính xác (ví dụ: float32 → float16 hoặc int8).

Đưa mô hình vào đúng định dạng ngay từ đầu giúp tránh những bất ngờ đau đầu sau này khi tích hợp với ứng dụng hoặc firmware.

Chọn phần cứng phù hợp không chỉ là một chi tiết kỹ thuật - mà còn là một quyết định chiến lược có thể mở khóa những trải nghiệm người dùng tốt hơn, thời gian sử dụng pin lâu hơn, chi phí thấp hơn và thời gian đưa ra thị trường nhanh hơn. Bằng cách khớp nhu cầu của mô hình với khả năng của thiết bị, bạn có thể tạo ra những giải pháp AI biên tuyệt vời mà cảm giác mượt mà, thông minh và liền mạch.

Trong phần tiếp theo, chúng ta sẽ chuyển từ việc xây dựng và nén mô hình sang việc thực sự triển khai chúng - và duy trì hoạt động tốt ở quy mô lớn.

## Quy trình Triển khai & Bảo trì Ở Quy Mô Lớn

### Tại Sao Việc Triển Khai Cần Sự Chú Ý Đặc Biệt

Việc đào tạo và nén một mô hình chỉ mới hoàn thành một nửa chặng đường. Thực sự đưa nó vào hoạt động đáng tin cậy trên hàng nghìn (hoặc triệu) thiết bị trong thế giới thực - và giữ cho nó được cập nhật và hiệu quả theo thời gian - là nơi nhiều dự án Edge AI gặp khó khăn.

Triển khai các mô hình thị giác trên các thiết bị nhỏ cần phải đóng gói cẩn thận, thử nghiệm kỹ lưỡng và lập kế hoạch cho các bản cập nhật trong tương lai. Hãy cùng khám phá quy trình triển khai thông minh trông như thế nào.

### Bước 1: Xuất Và Tối Ưu Mô Hình

Khi mô hình của bạn đã được đào tạo và nén xong, bước tiếp theo là **xuất** nó sang định dạng mà thiết bị mục tiêu của bạn có thể sử dụng.

**Các định dạng phổ biến cho thiết bị biên:**

- TensorFlow Lite (.tflite): Tuyệt vời cho Android, vi điều khiển và Coral Edge TPU.

- ONNX (.onnx): Tiêu chuẩn mở linh hoạt, hỗ trợ nhiều môi trường chạy khác nhau.

- Core ML (.mlmodel): Cần thiết cho các thiết bị iOS (iPhone, iPad).

- NNAPI / Metal: Các lớp tăng tốc phần cứng bản địa cho Android và iOS.

**Tối ưu hóa trong quá trình xuất khẩu:**

- Áp dụng quantization sau đào tạo nếu cần.

- Loại bỏ các phép toán không sử dụng để đơn giản hóa đồ thị của mô hình.

- Giảm độ chính xác (ví dụ: float32 → float16 hoặc int8).

Đưa mô hình vào đúng định dạng ngay từ đầu giúp tránh những bất ngờ đau đầu sau này khi tích hợp với ứng dụng hoặc firmware.

Reference Articles

Edge AI và Edge Computing: Cung cấp năng lượng cho trí ...

Trong bối cảnh thị giác máy tính, Edge AI có thể giúp các thiết bị như camera hỗ trợ AI phát hiện vật thể, nhận dạng khuôn mặt và giám sát ...

Source: Ultralytics

ALL

ALL Máy móc chính xác

Máy móc chính xác

Related Discussions

Chào mọi người! Mình đang tìm hiểu về Edge AI Vision và rất muốn có thêm tài liệu hoặc thông tin chi tiết về các kỹ thuật nén mô hình và lựa chọn phần cứng. Ai có thể chia sẻ kinh nghiệm hoặc nguồn tài nguyên hữu ích không? Cảm ơn nhiều!

Edge AI Vision đang mở ra nhiều cơ hội mới cho các ngành công nghiệp toàn cầu. Việc xử lý dữ liệu tại chỗ không chỉ tăng tốc độ phản hồi mà còn giúp tiết kiệm chi phí và nâng cao bảo mật. Thật thú vị khi thấy cách công nghệ này đang thay đổi cách chúng ta tiếp cận dữ liệu!